最佳答案

DeepNude、DeepFake和原谅宝的故事告诉我们,技术可以前所未有地、轻而易举地使人拥有权力,他们可以通过大数据操纵任何一个普通人的生活,让你感到恐惧,让你的隐私变成

DeepNude、DeepFake和原谅宝的故事告诉我们,技术可以前所未有地、轻而易举地使人拥有权力,他们可以通过大数据操纵任何一个普通人的生活,让你感到恐惧,让你的隐私变成商品公之于众。

作者 | 石灿

编辑 | 铁林

DeepNude(深度裸体)App的出现,令美国女性感到害怕。四天的时间,这种害怕扩散演变成了全球性恐慌。

一名叫阿尔贝托的程序员开发出了这款应用。只要你给DeepNude一张女性图片,借助神经网络技术,它就可以自动“脱掉”女性身上的衣服,显示出那位女性的“裸体”来。

有人问,DeepNude能对男性造成直接伤害吗?从目前的情况来看,不会。它只能处理女性图片,即便上传男性图片,最后输出的图片中,关键隐私部位也会显示为女性。

“低级需求下产生的应用,是有原罪的。”

6月23日,DeepNude在一个网站上首度被展示,上面罗列了人们该如何下载并使用这款软件的步骤信息。

DeepNude有免费版和50美元付费版,使用免费版获得的图片会有较大水印,付费版不会出现较大水印,但在图片左上角会加上“FAKE”的小logo。

使用者无需任何专业知识,就可轻而易举地使用,技术削低了准入门槛。有人好奇了问:DeepNude是怎么诞生的?

两年前,开发者阿尔贝托发现了人工智能的潜力,开始研究这门技术的基础知识。当他知道人工智能技术能将白天照片转换成夜间照片时,他意识到,自己可以将一张穿着衣服的女性照片,转换成另一种模样的照片。

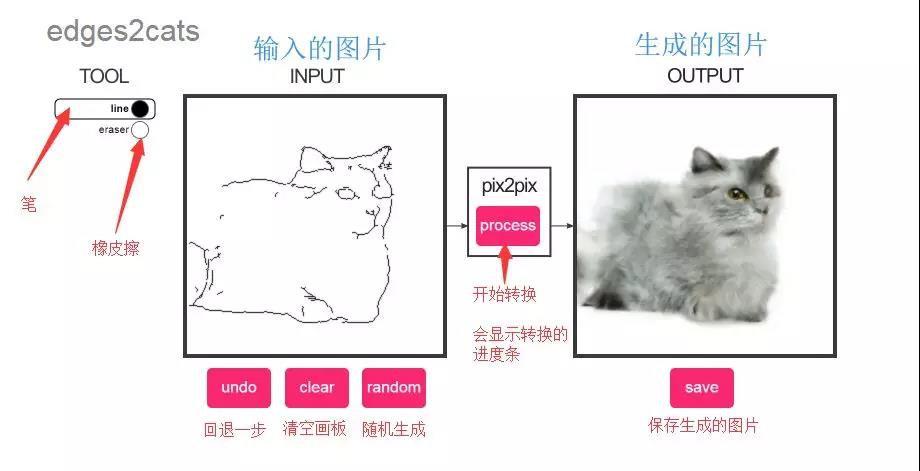

阿尔贝托在接受《Motherboard》的采访时说,DeepNude基于加州大学伯克利分校研究者开发的开源算法pix2pix创建,并使用1万张女性裸图加以训练。这一算法与人工智能换脸技术DeepFake算法相似,也和无人车技术所使用的算法相似。

图片来自GitHub社区,账号“yuanxiaosc”

他把这种发现滋生出来的结果理解为乐趣和热情。凭借这两个驱动力,他对穿着衣服的女性照片做了一次“卸装”尝试,并从中获得了“有趣的结果”。

但这并不是让他创建DeepNude的核心原因,到底是什么让它创建了一个饱受争议的应用呢?

《Motherboard》的报道为我们解答了这一疑惑。

此前,阿尔贝托创业失败了,在经济上遭遇困境,“我问自己,是否能凭借这个算法技术赚到钱”?

答案是肯定的。

短短五天内,就有50万人在使用DeepNude。巨大的流量一度使服务器不稳定,导致付款出现问题。他一直在社交媒体推特上安抚用户,“We had problems with payments. Please try later or use crypto.”(我们的付款出现问题,请稍后再试或使用加密。)

DeepNudeApp的Twitter账号界面截图

6月26日当天,用户量太大,他被迫关闭服务器。还说,在解决问题之前,不接受任何付款。

DeepNude推出四天后,阿尔贝托还没意识到有人在用它做一些充满恶意的事情。6月27日,连发了5条推特阐述团队在努力维修DeepNude的下载通道和支付通道,“耐心点,我们将在未来发布越来越稳定的版本。”

即便如此,他们还是离线了,人们下载不了DeepNude,原因不是封禁,而是“因为我们没有预料到这么多访问,我们的服务器需要加强。”

DeepNude太火爆了。它能让人轻而易举地看到一些明星的隐私,哪怕是合成的。时间前进到6月27日晚些时间,阿尔贝托才被迫做出妥协,决定关停DeepNude。

“我们以为我们每个月都能以一种可控的方式销售很少的DeepNude”,但“我们从未想过它会变成病毒,发展到了不可控的状态”,“人们滥用它的可能性太高了,我们不想这样赚钱”,“从现在起,DeepNude将不再发布其他版本,也不允许任何人使用它”。

DeepNude网站的一部分屏幕截图

阿尔贝托的口头阻止令毫无效果,至今仍有DeepNude在网络上传播。

就在这一消息发布前几小时,他还在认为“世界还没有为DeepNude的到来做好准备”。

“‘世界尚未准备好’?我想你的意思是‘我们编写了一个深刻攻击性、令人毛骨悚然的应用程序,它基本上是一个滥用和侵犯人们隐私的应用程序,我们很抱歉’。”一位Twitter网友看起来很生气,她不认同阿尔贝托的说辞。

“低级需求下产生的应用,是有原罪的。”国内一名叫“潘一先生”的网友谴责称,DeepNude满足的本就不是正当合法的需求。和真实图像相比,如果说生成的照片与女性很像,那么侵犯了女性的隐私权;如果说不像,则可能侵犯女性的名誉权。

世界永远不应该为像DeepNude这样的应用做好准备,而且也不应该这样做。

但就在DeepNude被抵制之前,DeepFake(深度伪造,多用于换脸)技术也充满了争议。

杨幂和蔡徐坤都被“换脸”

去年12月,一段涉及漫威电影《神奇女侠》主演盖尔·加朵的“成人短片”,在一个类似于贴吧一样的美国网络社区Reddit流传,被诸多网友围观。制作这段视频的人不是职业拍摄者,而是一名程序员,网名叫“deepfakes”。

他在业余时间学习了DeepFake技术,用一些互联网免费开放的工具和素材,将盖尔·加朵的脸“移植”到了一名色情演员身上。盖尔·加朵与那部“成人短片”产生联系,是非自愿行为。

但那位程序员显然是沉迷其中了。泰勒·斯威夫特、艾玛·沃特森、斯嘉丽·约翰逊和麦茜·威廉姆斯等在美国家喻户晓的女明星都被换脸。

给女明星换脸,国内也出现过类似的网络事件。那件事发生在今年初。

把杨幂推进换脸风波的人,在微博开通了一个叫“换脸哥”的账号。2月底,他把一段涉及杨幂的视频上传到网络,引发热议。视频内容的主角原本是《射雕英雄传》中黄蓉的扮演者朱茵,但他用DeepFakes技术把朱茵的脸换成了杨幂的脸。

一方面,很多人担心自己会被同样的技术裹入洪流,被人玩弄,开始谴责他;一方面,有人找到他,希望他帮忙做换脸技术,其中不少涉及违法犯罪。没过多久,他与杨幂官方工作室沟通,并下架了相关视频。

最为人熟知的换脸恶搞潮发生在今年初的“鸡你太美事件”中,蔡徐坤展示自己兴趣爱好的一段视频,被网友换脸,他们还陆续推出了新的恶搞版本。蔡徐坤方面为避免被恶搞,还发出了律师函警告。

蔡徐坤的换脸主角是游戏知名主播五五开

DeepFake的发展时间不长,在2017年底才兴起的,被主流深度讨论,也是那时。几个月后,Reddit禁止上传非自愿色情内容,其他网站也禁止使用深度伪造非自愿色情内容。

它的危害之一在于,技术权力毫无约束,像疯狗一样逮谁咬谁,很容易让人被技术另一端的人支配。

演员斯嘉丽·约翰逊是世界上收入最高的女演员之一,以参演漫威系列电影而闻名,江湖人称“黑寡妇”。她却深受DeepFake之害。

斯嘉丽·约翰逊

《华盛顿邮报》称,她的脸已经被匿名在线“创作者”嫁接到数十个图形性爱场景中,他们正在使用免费的人工智能软件来制作令人信服的逼真视频。一个假视频,被描述为真正的“泄露”镜头,已被观看超过150万次。

在现代名望的黑暗现实中,她拥有比大多数人更多的经验。2011年,她被一名黑客泄露隐私,这名黑客后来被判处10年有期徒刑。

在线制作虚假的色情照片已经存在了几十年。她在接受《华盛顿邮报》采访时说,DeepFakes的崛起,已被用来骚扰和羞辱女性,这对于寻求在互联网上保护自己的女性来说,是一个新的令人沮丧的挑战。她对这一现象表示担忧,将互联网描述为“吃掉自己的巨大黑暗虫洞”。

在英国,DeepFakes的生产者可能会因骚扰而受到起诉,但有人要求对某种特定犯罪行为进行深刻打击。《卫报》称,一位学术专家认为,根据真实人物的照片制作虚假的色情图片应该成为修正法案中的刑事犯罪,以解决骚扰问题。

在美国,人们一直在追究身份盗窃,网络跟踪和复仇色情等各种指控,并讨论了更全面的法规。据“机器之心”的报道,目前,美国弗吉尼亚州率先对DeepFakes这些新应用采取了行动,扩大了其“复仇色情法”的范畴。修正后的法律于当地时间7月1日生效。

2014年,弗吉尼亚州对“复仇色情”的定义是,“以完全或部分裸体状态恶意传播另一个人的录像或静止图像,意图强迫,骚扰或恐吓”。现在,这一法令包含了“DeepFake”,制作或操纵的视频和使用机器学习制作的图像。

现在的规定称,未经许可分享某人视频的裸照照片是违法的——无论是真实的还是伪造的。除了DeepFake,用Photoshop或其他工具制作的虚假照片、视频也包含在内。

在现有状况来看,这项法案保护的大多是女性。有数据显示,大约有1000万美国人受到复仇色情的威胁或成为其复仇的受害者。根据美国一家研究所2016年的一项研究,女性遭受男性威胁的可能性是男性的两倍。

为什么受伤的总是女性?

用“深度假”技术取悦人们

2018年8月13日,一个叫“原谅宝”的项目崭露头角,微博网友“将记忆深埋”发文称,为了帮助码农朋友们做一个初步过滤,他联合了几位朋友把1024、91等网站上的视频和图片打上标签,进行人脸匹配。

在码农界一直流传着一个说法,很多码农每天的时间都分配给了工作,加上天生情商不够高,内心又想着找一个女朋友,在找女朋友方面,很不擅长。这可能导致一个情况,有些码农找到的女朋友可能是“特殊工作者”,或者是“炮友”,或者是被偷拍女性,或者是其他情况。

发起者称,“原谅宝”起到的一个作用就在于,鉴别对方有没有出现在1024、PronHub等特殊网站上。

使用方法不难,你可以上传一张照片到“原谅宝”,系统会自动匹配1024、PronHub等特殊网站上的数据,如果结果显示“Fail”,意味着那个人的样貌出现在了特殊网站上;如果显示“Pass”,则是“幸运过关”。

消息一出,引来无数质疑和谩骂。“原谅宝”则为自己辩解,研发的目的是“为保护老实人而生”“接盘侠的福音”,可以解决恋爱中的信任关系。

5月27日,“将记忆深埋”说,“半年时间,100多TB数据, 利用1024、91、sex8、PronHub、xvideos 等网站采集的数据对比Facebook、instagram、TikTok、抖音、微博等社交媒体。我们在全球范围内成功识别了10多万从事不可描述行业的小姐姐。”

“知道这些素材够判断多少年吗?”有人看到这条信息后发出质问。

“你知道什么叫违法吗?首先,我现在没有传播任何数据,其次,我没有公布查询接口泄露任何人的隐私。”“将记忆深埋”在微博中为自己辩解,“我居住在德国,色情产业是合法的”。

“将记忆深埋”的嚣张气焰并没有变弱的趋势。直到舆论紧逼,无数人涌入他的个人微博主页,对其进行谴责。“将记忆深埋”不得不做出致歉,“我会删除这个项目”,“100多TB数据在半小时内彻底清空”。

此事没有就此终止,关于“原谅宝”以App方式转世的消息却传了出来,“将记忆深埋”将此事与自己撇清,“本人没有发布过任何手机端App”。但这些设计背后的动机天然针对女性,甚至于控制和羞辱女性。

我们习惯了太多事情了。对社交媒体习以为常的我们,早就接受了一个来自于技术世界的观念:技术本身是没有错的,即便是技术被披上了狼皮,也是人的错,它可以作恶,也可以行善。但在今年,科技向善的价值观导向逐渐成为主流,即便有人在抨击这一观念非常模糊,也阻止不了它在这一阶段的流行程度。

但DeepNude、DeepFake和原谅宝的故事告诉我们,技术可以前所未有地、轻而易举地使人拥有权力,他们可以通过大数据操纵任何一个普通人的生活,让你感到恐惧,让你的一切网络隐私变成商品公之于众。它已经不再是一个单纯的技术问题,而是一个社会信任问题,从个人信任到新闻信任,我们可能陷入一个再也无法确定媒体内容是否符合事实的时代。

“深度假”技术变得越来越流行,不论是在抖音、快手上的动画特效,还是美颜相机里面的猫咪耳朵,都变花样儿地讨好人们。如果说技术本身是中立,那么道德的存在,就是为了引导技术别轻易成为“吃掉自己的巨大黑暗虫洞”。

当《Motherboard》的记者向美国加州大学伯克利分校计算机科学教授Hany Farid展示DeepNude时,得知其发展到这种程度,他感到震惊。

他说,学术界和研究人员不得不更加带有批判性的视角,考虑我们该如何推进技术,以便技术不被武器化,或以有害的方式被使用。

很多AI研究者也针对DeepNude事件发声,大多是谴责。

3月份,吴恩达和他的女儿/图片来自吴恩达的Twitter账号

“我很高兴DeepNude死了。作为一个人和一个父亲,我认为这是人工智能最令人作呕的应用之一。”前百度首席科学家、斯坦福大学CS兼职教师吴恩达,在社交媒体发文表达了他的愤怒。

他还告诫AI社区和社员们:“你的确拥有超能力,你建立的东西很重要。请将你的力量用在可以推动世界前进的有价值的项目上。”

(文中部分内容根据编译资料整理)